(图片来源:网站“北京脑科学与类脑研究所”)

2026年1月6日,北京脑科学与类脑研究所崔翯实验室在 Advanced Intelligent Systems 杂志发表题为 “Controllt: A Universal Framework for Translational, Adaptive, and Online Brain–Computer Interfaces” 的研究,提出了灵活、通用、跨模态且可扩展的脑机接口框架 Controllt ,为脑机接口从实验室研究走向大规模临床应用提供系统化平台支撑。

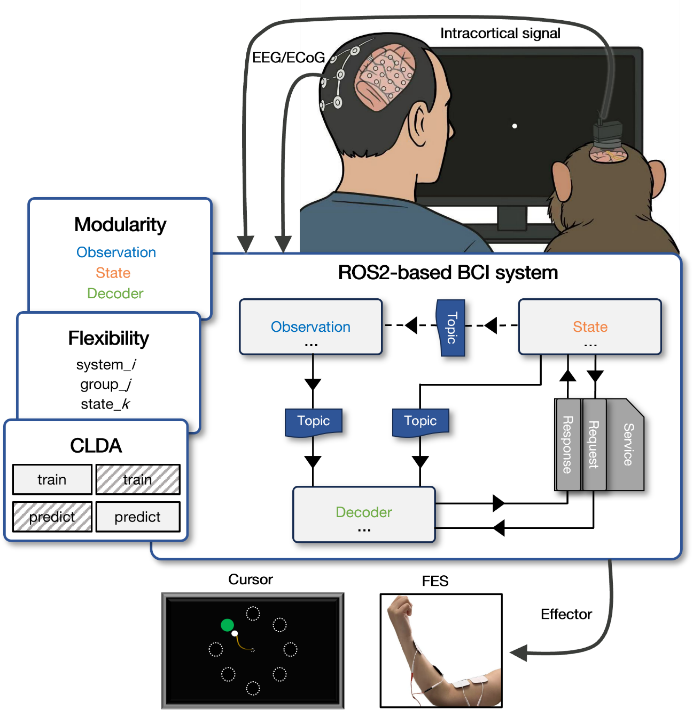

尽管脑机接口(BCI)发展迅速,但要实现稳定的在线闭环控制,仍缺少一个灵活、可扩展且支持神经适应的通用框架。研究者基于ROS2提出了新的BCI框架Controllt。它通过Observation、State、Decoder三个独立节点的模块化组合,兼容spike/EEG/ECoG等多种信号,并支持闭环解码自适应(CLDA,Closed-Loop Decoder Adaptation),为多场景BCI的实验室研究与临床转化提供了统一基础。

得益于独立、模块化和可扩展的设计,Controllt具备很强的通用性与迁移能力,不再受限于特定的信号类型、受试者对象或实验范式;神经信号既可来自侵入式神经元放电(spike),也可以是非侵入式EEG或半侵入式ECoG;受试者可覆盖人类与非人灵长类;任务范式与解码器支持分类或连续回归控制(图1)。

图1. ControlIt框架示意图

Controllt将完整的脑机接口闭环流程拆分为三个相互解耦的核心模块:负责信号采集与预处理的Observation,负责任务流程与范式呈现的State,以及执行实时解码与输出的Decoder。在ROS2架构下,这三个模块分别以独立节点的形式运行,使研究者能够根据不同实验需求自由组合和扩展模块。模块间的信息交互主要依赖ROS2的两种通信机制,Topic用于数据的持续发布与订阅(如神经特征、状态标签等),而Service则用于解码请求与结果返回的一对一交互。

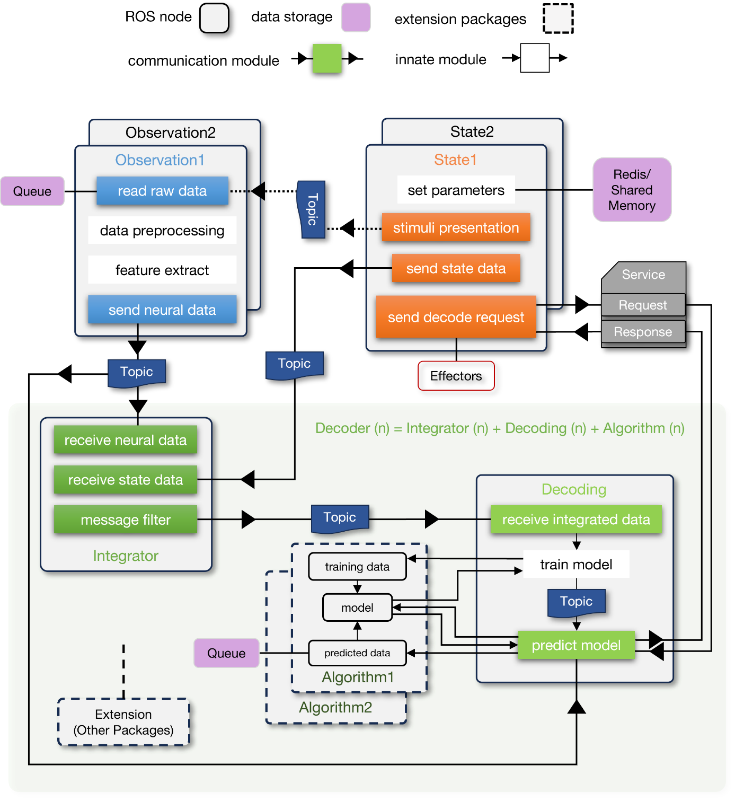

Controllt整体工作流程即为三个核心模块的协同运行。其中,Observation模块负责对接不同电生理采集设备,获取原始神经信号,并完成必要的预处理与特征提取;随后将处理后的神经特征通过Topic进行广播,为后续解码提供输入。State模块则面向具体实验范式,负责任务流程与提示的呈现,并在合适的时间节点将运动状态标签(如离散意图类别)或连续运动状态(如速度、轨迹等)同样通过Topic发布出来。在系统交互方面,解码请求与返回结果采用Service进行一对一通信:Decoder在接收到解码请求后输出预测结果,再由控制端根据返回的解码输出驱动外设执行相应动作(例如光标移动、FES 触发或其他设备控制)。Decoder模块内部进一步拆分为Integrator、Decoding与Algorithm三个子模块。Integrator借助ROS2的message_filters工具,对Observation与State发布的异步消息进行时间对齐与整合,构建成标准化的样本数据并传递给Decoding。Decoding负责实时在线解码流程的调度,而为了便于将离线训练的解码器无缝迁移到在线闭环场景,Controllt将模型的训练与推理逻辑统一封装在可扩展的Algorithm模块中,使不同算法可以以插件式方式接入并被在线调用。与此同时,框架还引入Queue、SharedMemor与Redis等数据存储与通信机制,用于神经数据缓存、系统参数跨模块共享等(图2)。

图2. ControlIt闭环实现流程

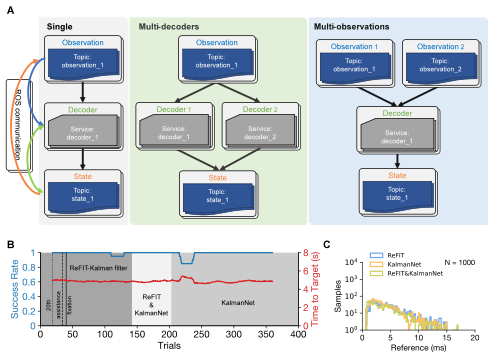

基于ROS2的Topic与Service通信机制,Controllt将Observation、State和Decoder作为独立节点进行解耦组合,使得研究者能够围绕同一套框架快速搭建不同的定制化实验场景。论文中给出了三类典型配置(context):single context、multi-decoder context和multi-observation context。其中,single context是当前脑机接口研究最基础的闭环形态,仅需各部署一个Observation、State与Decoder节点,即可完成信号采集->状态标注->在线解码->外设控制的完整流程。在此基础上,multi-decoder context通过增加额外的Decoder节点,使系统能够并行或分时运行多个解码器,既可以实现不同解码器在不同时间段的切换使用,也能在同一时间窗口对多种解码算法进行实时性能对比与评估,从而更高效地完成算法验证与在线更新。而multi-observation context则通过增加额外的Observation节点,支持多源信号的同步采集与处理,使框架能够自然扩展到多模态信号场景(例如同时使用来自不同脑区或不同记录方式的信号),为多模态融合解码提供基础。进一步地,当multi-observation与multi-decoder组合使用时,系统便可以实现不同脑区不同解码方法的实时在线解码配置,例如针对不同脑区信号分别采用最适配的解码策略,并在同一闭环场景下并行输出解码结果(图3)。

图3. BCI不同场景配置示例与实验结果

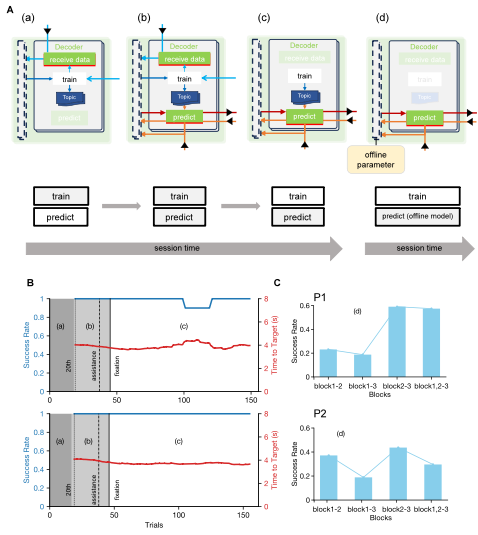

脑机接口的学习过程本质上依赖于神经适应与神经可塑性。为了加速这一过程,Controllt支持CLDA机制,系统可根据受试者的实时表现在线更新解码器参数,使解码器与用户行为形成双向适应,从而在更短时间内促进与BCI任务相关的神经回路建立。在框架实现上,Controllt将解码模块中的模型训练(Train model)与模型推理(Predict model)设计为两个相互解耦的组件。Train model通过调用Algorithm模块中的fit接口对模型进行拟合,得到可用于解码的模型参数,Predict model则利用实时神经活动数据与训练得到的参数进行推理,输出对应的行为预测结果(如意图类别或连续速度)。模型参数既可以通过Topic进行广播以支持在线动态更新,也可以保存为模型文件,便于复现实验或在后续阶段直接加载使用。Controllt支持四种运行模式:(a)仅训练不预测:可用于在线时后台观测模型解码情况;(b)边训练边预测:训练与推理同步进行,实现真正的在线自适应;(c)先在线训练、再固定参数预测:使用在线生成的参数进行预测,一旦进入稳定预测阶段便停止继续训练;(d)直接使用离线模型预测:加载预训练模型,仅进行在线推理,无需在线训练(图4)。

图4. CLDA的实现方式与实验结果

该研究提出并验证了一个通用的脑机接口框架Controllt,旨在同时满足三项核心需求:(1)支持不同类型神经信号的实时在线解码,覆盖从非侵入式EEG到侵入式spike/ECoG等多种记录方式;(2)通过将系统拆分为Observation、State与Decoder三个可独立扩展的ROS2节点,实现模块化“搭积木”式组合,从而灵活支持多模态、多解码器等多样化BCI场景;(3)引入闭环解码自适应,使解码器能够根据受试者表现在线更新参数,加速用户与解码器的双向适应过程,促进性能更快趋于稳定。

论文信息

北京脑科学与类脑研究所崔翯实验室博士生杨晚林和博士后李晨阳为本文共同第一作者,北京脑所高级研究员崔翯,副研究员郑聪和天坛医院杨艺主任为本文共同通讯作者,北京脑所、芯智达和天坛医院等多位研究人员也积极参与并做出贡献。本研究得到国自然、科技部和芯智达项目的资助。

原文链接

http://doi.org/10.1002/aisy.202501148

—end—

资讯来源:网站“北京脑科学与类脑研究所”,网址https://www.cibr.ac.cn/#/detail/researchAchievementpaper/ba8e56e1eafc4e1b9323542c07a06768?lang=zh

论文来源:http://doi.org/10.1002/aisy.202501148

在线投稿

在线投稿 在线审稿

在线审稿 编辑管理

编辑管理 读者登录

读者登录 快速检索

快速检索 友情链接

友情链接